Uma nova técnica de ataque digital, revelada recentemente pela empresa de segurança LayerX, está chamando a atenção da comunidade tecnológica. Batizada de “font rendering” (renderização de fontes), essa abordagem explora uma diferença crítica entre o que os usuários veem na tela e o que os sistemas de IA realmente interpretam nos bastidores.

Como funciona esse tipo de ataque?

O método é engenhoso — e preocupante.

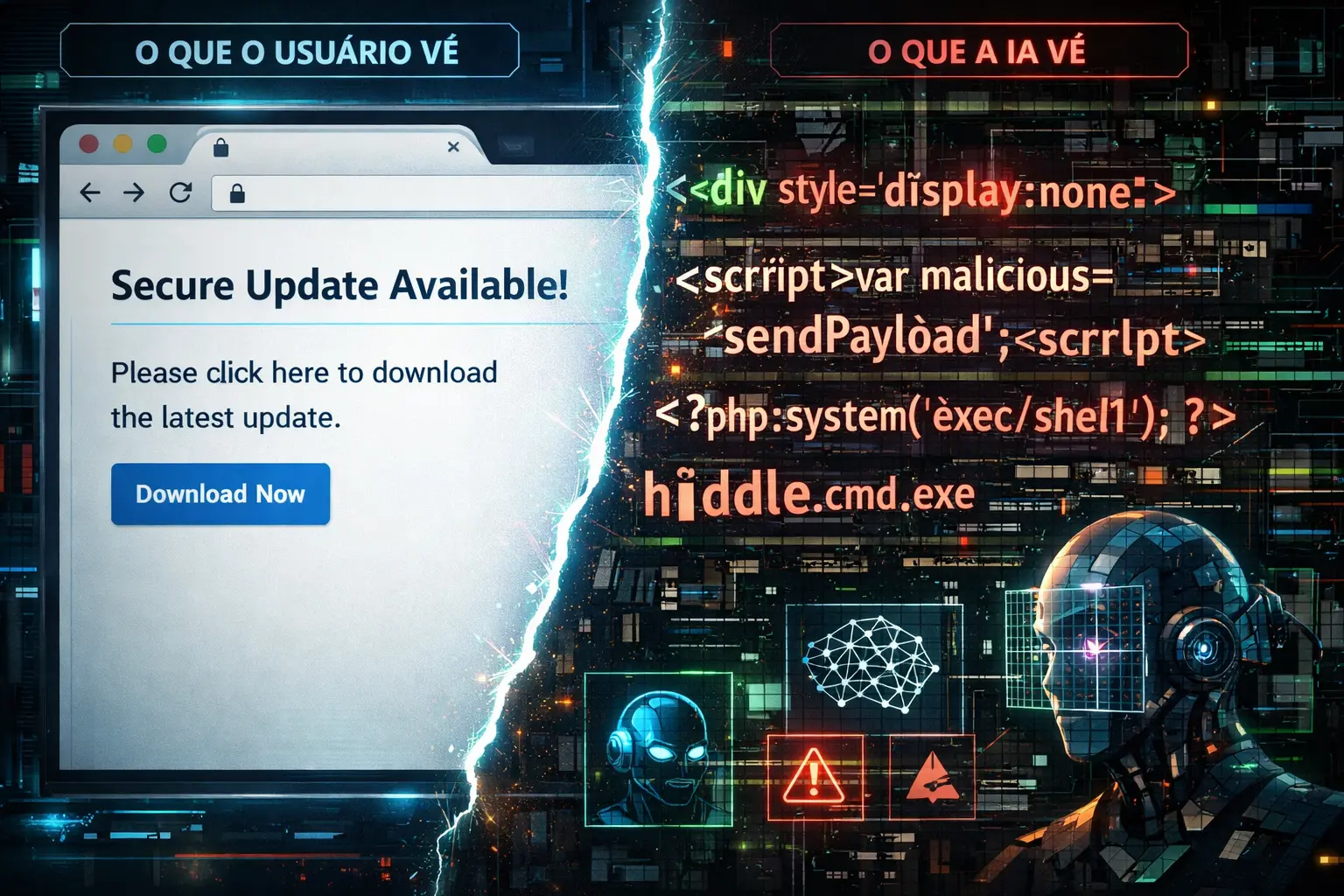

Os hackers utilizam fontes personalizadas e estilos CSS para manipular a forma como o texto é exibido. Na prática, isso cria uma espécie de “ilusão visual”:

- Mapeamento de caracteres alterado: letras aparentemente normais podem ser exibidas como algo inofensivo, enquanto o conteúdo real (como comandos perigosos) fica escondido.

- Manipulação visual com CSS: textos maliciosos podem ser ocultados com tamanho minúsculo ou cores invisíveis, enquanto instruções aparentemente seguras são destacadas.

Resultado?

👉 O usuário vê algo “seguro”.

👉 A IA analisa outra coisa completamente diferente.

Por que isso é perigoso?

Ferramentas como ChatGPT, Claude e Copilot analisam o texto real, não a forma como ele aparece visualmente no navegador. Isso abre espaço para ataques onde:

- A IA avalia um código como seguro

- O usuário, confiando nessa análise, executa comandos que na verdade são maliciosos

A LayerX demonstrou um exemplo prático:

um site disfarçado como “easter egg” de jogo incentivava o usuário a rodar um código. Ao pedir análise para uma IA, a resposta era de que o código era “totalmente seguro”. No entanto, ele continha instruções perigosas, como execução de reverse shell, que permite acesso remoto ao dispositivo da vítima.

Reação das empresas

A vulnerabilidade foi reportada em dezembro de 2025, mas as respostas variaram bastante:

- Microsoft: respondeu rapidamente e já corrigiu o problema.

- Google: inicialmente classificou como grave, mas depois rebaixou a importância, alegando dependência de engenharia social.

- Outras empresas: em sua maioria, consideraram o problema fora do escopo de proteção.

O que isso significa para você?

Esse caso reforça um ponto importante:

👉 Não confie cegamente em análises de IA quando se trata de segurança.

Mesmo ferramentas avançadas podem ser enganadas por técnicas sofisticadas de manipulação visual.

Boas práticas para se proteger:

- Evite executar códigos de fontes desconhecidas

- Desconfie de instruções encontradas em páginas suspeitas

- Use múltiplas fontes de verificação (não apenas IA)

- Sempre revise manualmente comandos antes de executá-los

Conclusão

A técnica de “font rendering” mostra que os ataques digitais estão evoluindo — explorando não apenas falhas técnicas, mas também a confiança dos usuários em ferramentas inteligentes.

A IA continua sendo uma aliada poderosa, mas não substitui o pensamento crítico e a cautela.