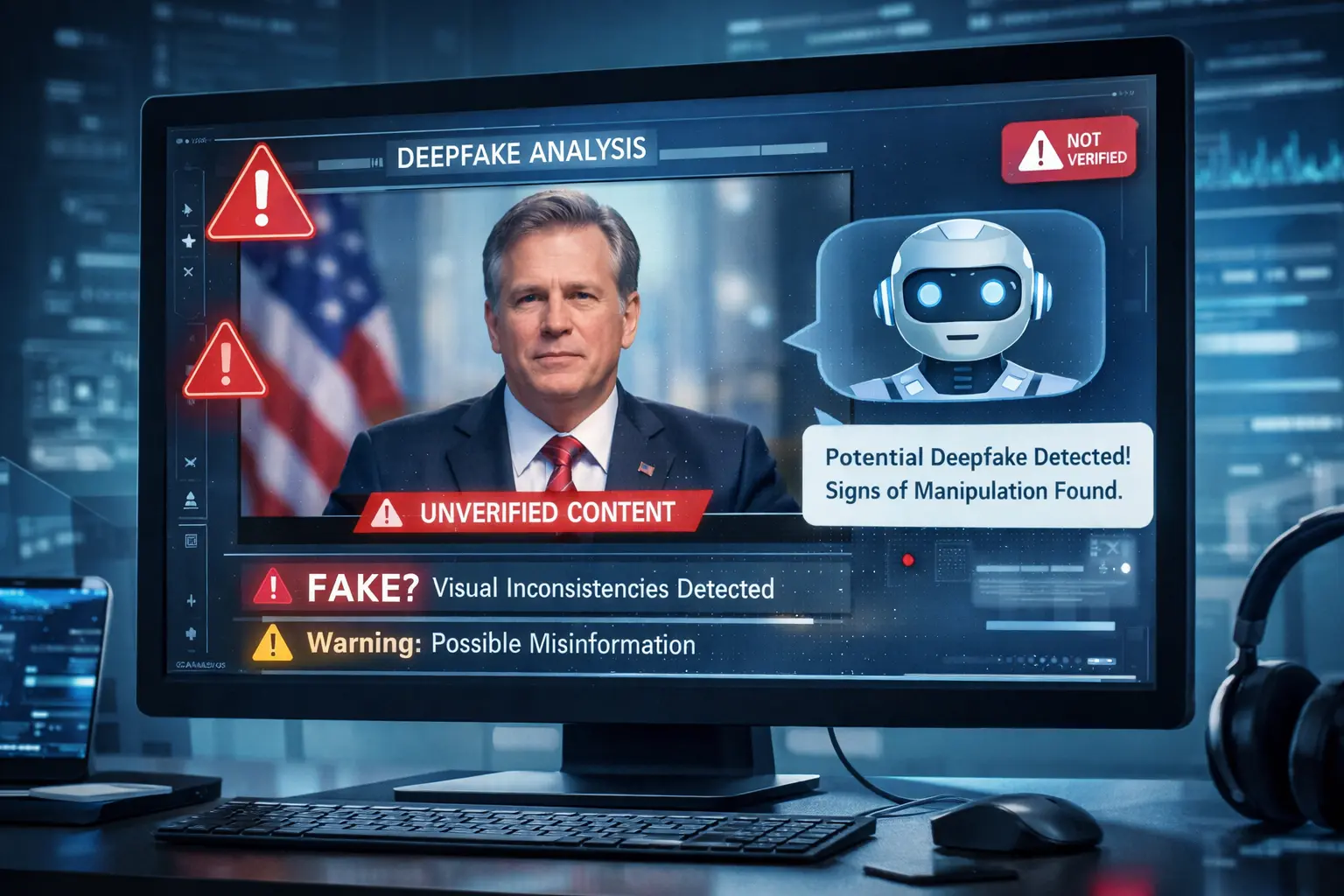

Recentemente, uma pesquisa realizada pela empresa de análise de mídia Newsguard revelou uma situação embaraçosa no campo da inteligência artificial: apesar dos avanços rápidos na tecnologia de geração de vídeos por IA, os chatbots de IA principais quase não conseguem identificar esses conteúdos “deepfake”, e nem mesmo as ferramentas dos próprios desenvolvedores conseguem se salvar.

O estudo mostrou que, ao se deparar com vídeos falsificados gerados pelo modelo de vídeo OpenAI Sora, o ChatGPT apresentou um desempenho decepcionante, com uma taxa de erro de 92,5%. Isso significa que, para a maioria dos vídeos gerados pelo Sora, o ChatGPT os reconheceria erroneamente como gravações reais. Outros gigantes também tiveram um desempenho ruim, com a taxa de erro do Grok, da xAI, chegando a 95%. O Google Gemini apresentou uma taxa de erro mais baixa, mas ainda assim chegou a 78%.

O que é ainda mais preocupante é que as medidas de proteção atuais são praticamente inúteis. Embora o Sora adicione uma marca d’água visível e metadados invisíveis nos vídeos gerados, a pesquisa constatou que esses sinais podem ser facilmente removidos com ferramentas gratuitas ou uma simples ação de “salvar como”. Quando a marca d’água desaparece, os chatbots não apenas falham em identificar a falsificação, como às vezes chegam a “inventar” fontes fictícias para validar a autenticidade dos vídeos falsificados.

Diante dessa situação, a OpenAI reconheceu que o ChatGPT ainda não tem a capacidade de distinguir se um conteúdo foi gerado por IA. Como as ferramentas de vídeo de ponta já conseguem produzir material quase impossível de distinguir a olho nu, e as contramedidas estão atrasadas em relação ao desenvolvimento tecnológico, isso cria um grande risco para a propagação de desinformação.