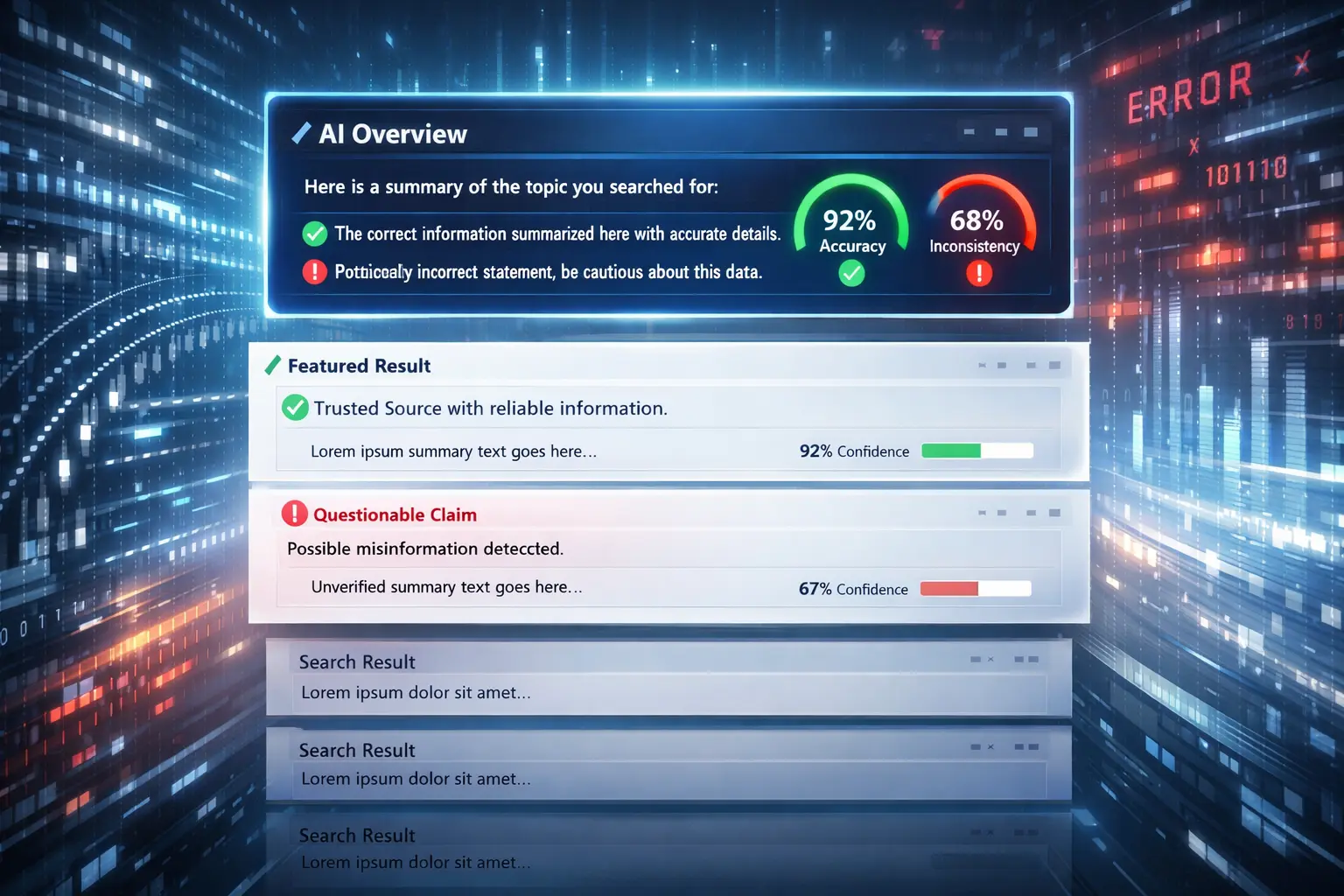

Recentemente, uma reportagem do entity[“organization”,”The New York Times”,”US newspaper”] trouxe à tona um dado impressionante — e ao mesmo tempo preocupante — sobre o recurso de “AI Overviews” do entity[“company”,”Google”,”technology company”]. Embora a taxa de precisão esteja em torno de 90%, o volume gigantesco de buscas na internet faz com que até mesmo uma pequena margem de erro gere consequências em larga escala.

📊 O problema em escala global

O Google processa mais de 5 trilhões de buscas por ano. Isso significa que, mesmo com 90% de precisão, o sistema pode gerar:

- Mais de 57 milhões de respostas incorretas por hora

- Quase 1 milhão de erros por minuto

Ou seja, a questão não é apenas a taxa de acerto — mas sim o impacto do erro quando aplicado em escala massiva.

📈 Evolução dos modelos, mas com ressalvas

A startup Oumi analisou 4.326 resultados de busca utilizando o benchmark SimpleQA. Os dados mostram evolução:

- Gemini 2 (outubro): 85% de precisão

- Gemini 3 (fevereiro): 91% de precisão

Apesar da melhora, há um ponto crítico:

➡️ A inconsistência entre os resumos gerados e as fontes originais aumentou significativamente.

- Gemini 2: 37% de inconsistência

- Gemini 3: 56% de inconsistência

Isso indica que, mesmo quando a resposta parece correta, ela pode estar baseada em fontes erradas ou mal interpretadas.

⚠️ Risco de desinformação e manipulação

Outro ponto preocupante é a facilidade com que o sistema pode ser influenciado:

- Um jornalista publicou um blog falso

- No dia seguinte, o conteúdo apareceu como fonte em um resumo da IA

Isso mostra que o sistema ainda pode ser vulnerável à manipulação, especialmente quando conteúdos enganosos são publicados rapidamente.

🤔 Contradições que afetam a confiança

Casos reais também revelam inconsistências curiosas. Um usuário pesquisou sobre a morte do lutador Hulk Hogan:

- O resumo da IA dizia: “não há relatos confiáveis de sua morte”

- Logo abaixo, aparecia uma notícia com o título sugerindo o contrário

Esse tipo de contradição gera dúvida e reduz a confiança do usuário.

🧠 O debate continua

O Google questionou a metodologia da Oumi, afirmando que os testes não refletem o comportamento real dos usuários. Ainda assim, os dados levantam um debate importante:

👉 Até que ponto podemos confiar em respostas geradas por IA?

👉 Como equilibrar velocidade, escala e precisão?

✅ Conclusão

A inteligência artificial está evoluindo rapidamente e trazendo ganhos claros em eficiência. Porém, quando falamos de informação — especialmente em larga escala — precisão não é apenas um número, é uma responsabilidade.

Para o usuário comum, a recomendação é clara:

🔎 Use a IA como apoio, mas sempre verifique as fontes.