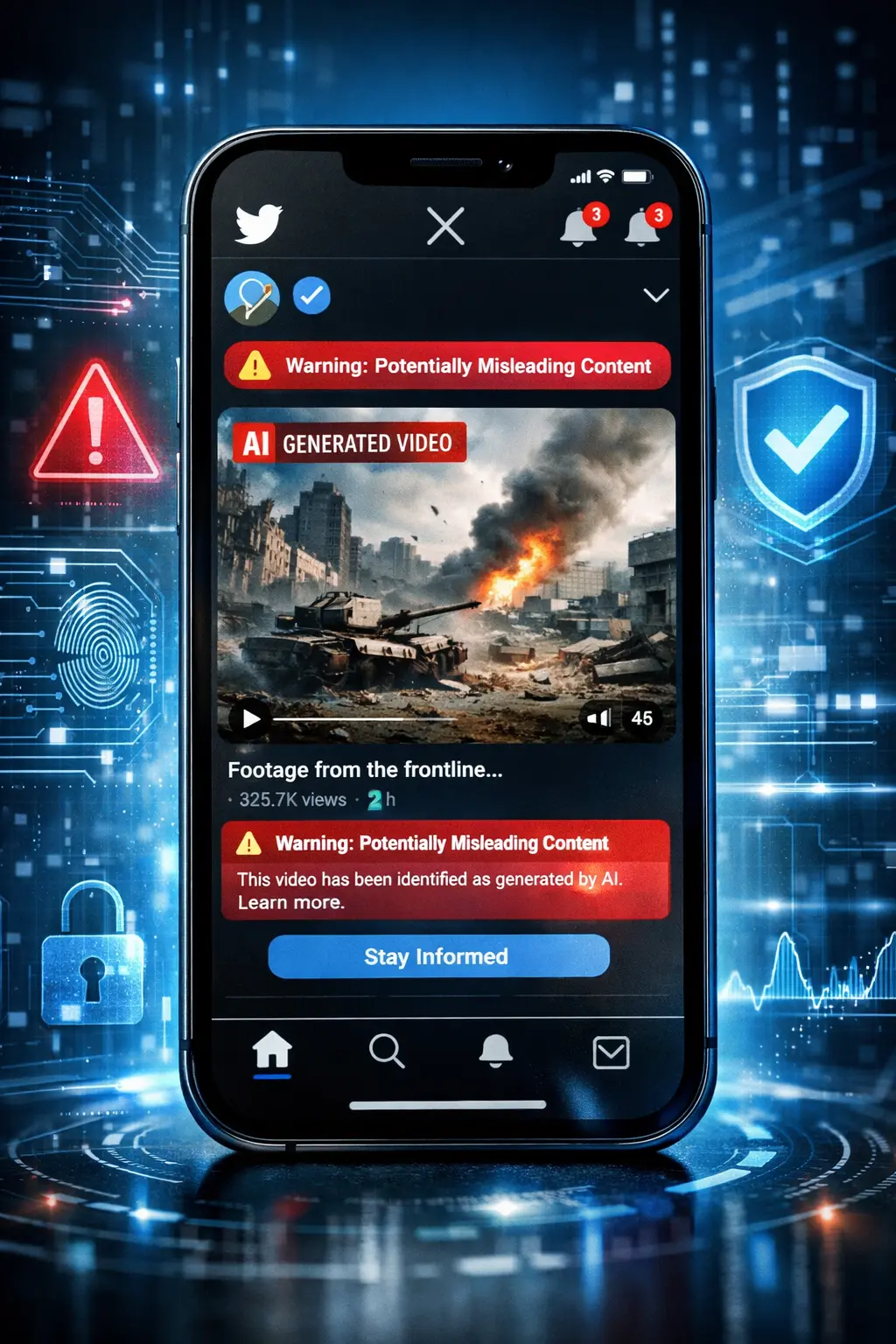

X (antigo Twitter) anuncia punições mais duras para vídeos de guerra gerados por IA sem identificação

A plataforma X, conhecida anteriormente como Twitter, anunciou nesta terça-feira novas medidas para combater conteúdos enganosos criados com inteligência artificial. A partir de agora, criadores que publicarem vídeos sobre conflitos armados gerados por IA sem deixar isso claro poderão sofrer punições severas dentro do programa de monetização da plataforma.

Segundo Nikita Bier, responsável pela área de produtos da X, qualquer usuário que utilizar inteligência artificial para produzir conteúdos capazes de enganar o público poderá perder o direito de participar do programa de divisão de receitas para criadores.

Suspensão e até banimento permanente

As novas regras são diretas:

- Primeira infração: suspensão de 90 dias do programa de monetização.

- Reincidência após a suspensão: banimento permanente da participação no programa de receitas.

Ou seja, mesmo que o criador continue usando a plataforma, ele não poderá mais ganhar dinheiro com seus conteúdos caso viole as regras novamente.

Combate à desinformação em momentos críticos

Bier explicou que, em momentos de crise — especialmente durante guerras ou conflitos armados — a precisão das informações é essencial. Com as ferramentas de IA cada vez mais acessíveis, tornou-se muito mais fácil criar vídeos falsos que parecem reais.

Para tentar identificar esse tipo de conteúdo, a X pretende combinar duas estratégias:

- Ferramentas de detecção de conteúdo gerado por IA

- Community Notes (Notas da Comunidade), sistema de verificação colaborativa usado pelos próprios usuários.

A ideia é criar um mecanismo de monitoramento mais eficiente para evitar que conteúdos manipulados se espalhem rapidamente.

Mudança tenta corrigir efeitos do programa de monetização

Essa atualização também busca resolver críticas que o programa de monetização da plataforma vinha recebendo. Muitos analistas afirmam que o sistema acabou incentivando conteúdos sensacionalistas ou emocionalmente manipulativos, já que postagens mais polêmicas tendem a gerar mais engajamento — e, consequentemente, mais receita.

Com isso, alguns criadores passaram a explorar temas delicados ou controversos apenas para aumentar visualizações, o que contribuiu para a disseminação de informações falsas ou distorcidas.

Medida ainda é considerada limitada

Apesar de ser vista como um avanço em termos de transparência e governança de conteúdo, especialistas apontam que a nova política ainda tem alcance limitado.

Atualmente, a regra se aplica apenas a conteúdos relacionados a conflitos armados. Outros tipos de desinformação potencialmente perigosos — como:

- desinformação política

- campanhas de manipulação durante eleições

- promoção enganosa de produtos criados com IA por influenciadores

ainda não estão sujeitos ao mesmo nível de punição.

Um desafio global das redes sociais

Com o crescimento acelerado das ferramentas de inteligência artificial, especialistas alertam que mídias geradas por IA podem ser facilmente usadas para manipulação e propaganda.

Nesse cenário, plataformas digitais enfrentam um desafio cada vez maior: equilibrar o incentivo à economia de criadores com a responsabilidade de garantir informações confiáveis.

A decisão da X é apenas mais um passo nesse debate global que envolve tecnologia, liberdade de expressão e combate à desinformação.