Hoje, a Alibaba anunciou oficialmente o lançamento do Wan2.7-Image, um modelo unificado de geração e edição de imagens que representa um grande salto na qualidade visual e na forma como interagimos com IA criativa. Mais do que melhorias estéticas, o modelo traz avanços estruturais que resolvem problemas antigos — como rostos genéricos e dificuldade em seguir instruções com precisão.

Adeus aos rostos “genéricos” da IA

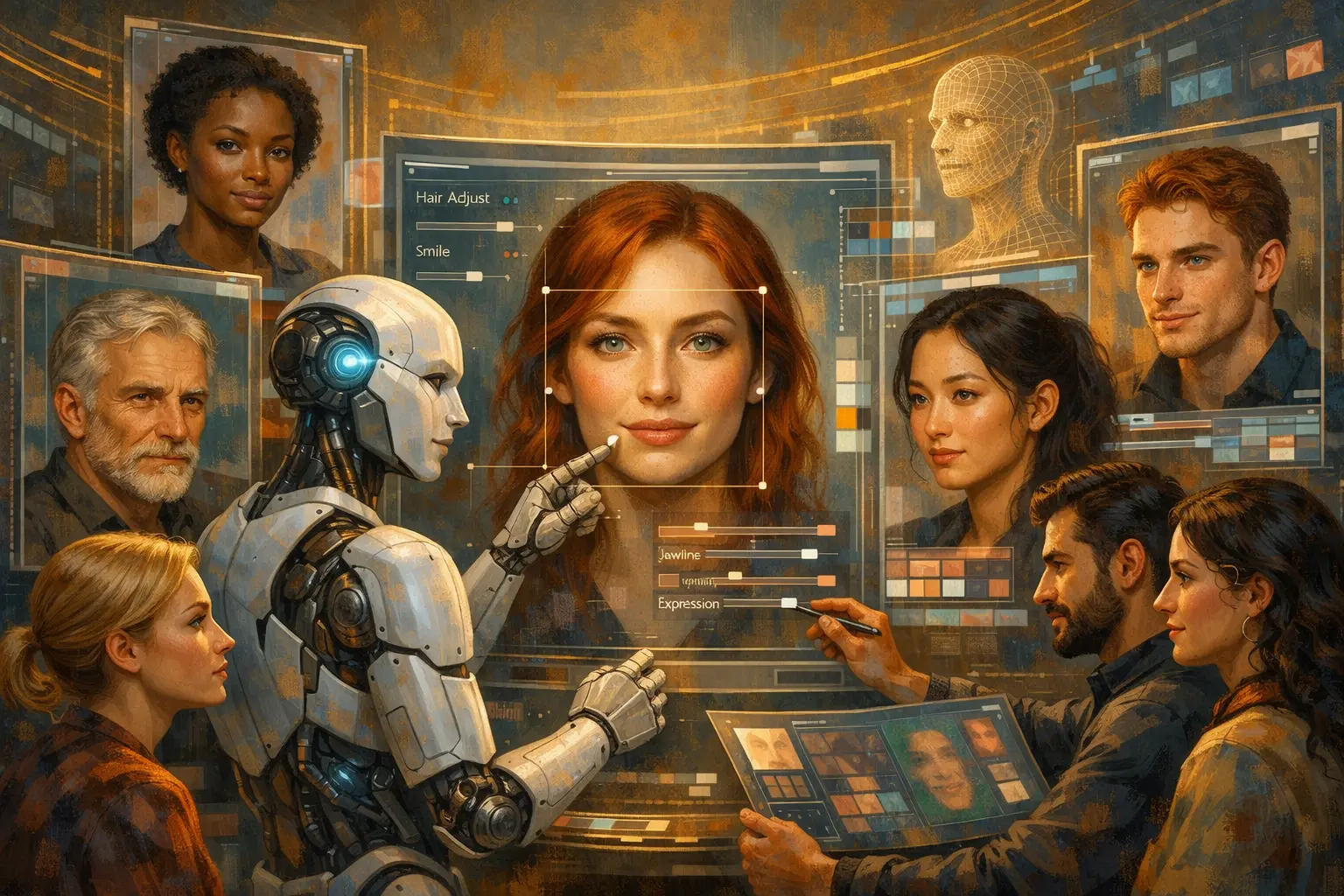

Um dos grandes destaques do Wan2.7-Image é a evolução na criação de personagens. Agora, é possível ajustar detalhes com muito mais precisão — desde a estrutura facial até características específicas como formato dos olhos, profundidade do olhar e traços únicos.

Na prática, isso significa sair daquele padrão repetitivo de “cara de IA” e entrar em uma nova fase de personalização real, onde cada personagem pode ser único. É o início de uma era de “mil rostos diferentes”, muito mais natural e expressiva.

Mais controle artístico com o novo “palette”

Outro recurso interessante é o sistema de “palette” (paleta de cores). Com ele, você pode extrair automaticamente as cores dominantes de uma imagem de referência — por exemplo, os tons vibrantes de Van Gogh ou as composições de Matisse — e aplicar esse estilo diretamente em novas criações.

Além disso, o modelo impressiona na renderização de textos longos. Ele suporta até 3.000 tokens e consegue gerar páginas completas com qualidade próxima à de impressão, incluindo fórmulas, tabelas e conteúdo estruturado em até 12 idiomas. Isso abre portas para aplicações em design, educação e produção de conteúdo profissional.

Edição interativa: “apontar e editar”

O Wan2.7-Image também traz uma experiência de edição muito mais intuitiva. Com simples seleções na imagem, é possível mover, substituir ou ajustar elementos com precisão quase pixel a pixel.

Por exemplo:

- Trocar a posição de pessoas na imagem

- Substituir objetos (como trocar gelo por frutas)

- Ajustar alinhamento e composição visual

Tudo isso de forma direta e rápida, sem precisar refazer a imagem do zero.

Consistência entre múltiplos elementos

Outro avanço importante é a capacidade de manter consistência entre múltiplos sujeitos. O modelo suporta até 9 imagens relacionadas, mantendo estilo, identidade visual e características coerentes.

Isso é especialmente útil para:

- Criar grupos de personagens (como bandas ou equipes)

- Produzir catálogos de produtos com identidade visual uniforme

- Desenvolver cenas complexas com vários elementos

Tecnologia por trás da evolução

No nível técnico, o Wan2.7-Image utiliza uma arquitetura unificada de geração e compreensão, baseada em um espaço latente compartilhado. Em vez de apenas “adivinhar” pixels a partir do texto, o modelo entende melhor o significado por trás das instruções.

Também já está disponível a versão Wan2.7-Image-pro, que oferece ainda mais estabilidade na composição e precisão na interpretação dos prompts.

Aplicações práticas

O modelo já está sendo utilizado em diversas áreas, como:

- Produção de vídeos e conteúdo (inclusive com múltiplos personagens interpretados por uma única pessoa)

- E-commerce (geração de imagens de produtos e modelos)

- Educação e pesquisa

- Entretenimento e redes sociais

Como acessar

Você pode experimentar o Wan2.7-Image através das seguintes opções:

- Plataforma oficial: https://tongyi.aliyun.com/wan

- API (China): https://bailian.console.aliyun.com

- API (Internacional): https://modelstudio.console.alibabacloud.com

Com esses avanços, o Wan2.7-Image não é apenas mais um modelo de geração de imagens — ele redefine o padrão do que esperamos da criatividade com IA, trazendo mais controle, realismo e possibilidades para desenvolvedores e criadores ao redor do mundo.