Em meados de março, diversas organizações de segurança infantil em todo o país receberam um e-mail de um grupo chamado “Aliança de Segurança de Pais e Crianças em IA”. A mensagem convidava essas instituições a apoiarem uma série de propostas de políticas públicas relacionadas ao uso de inteligência artificial por crianças.

Entre as propostas estavam medidas consideradas pouco controversas, como:

- verificação de idade,

- controle parental,

- proibição de publicidade direcionada a menores.

Até aí, tudo parecia alinhado com a proteção infantil. O problema surgiu depois.

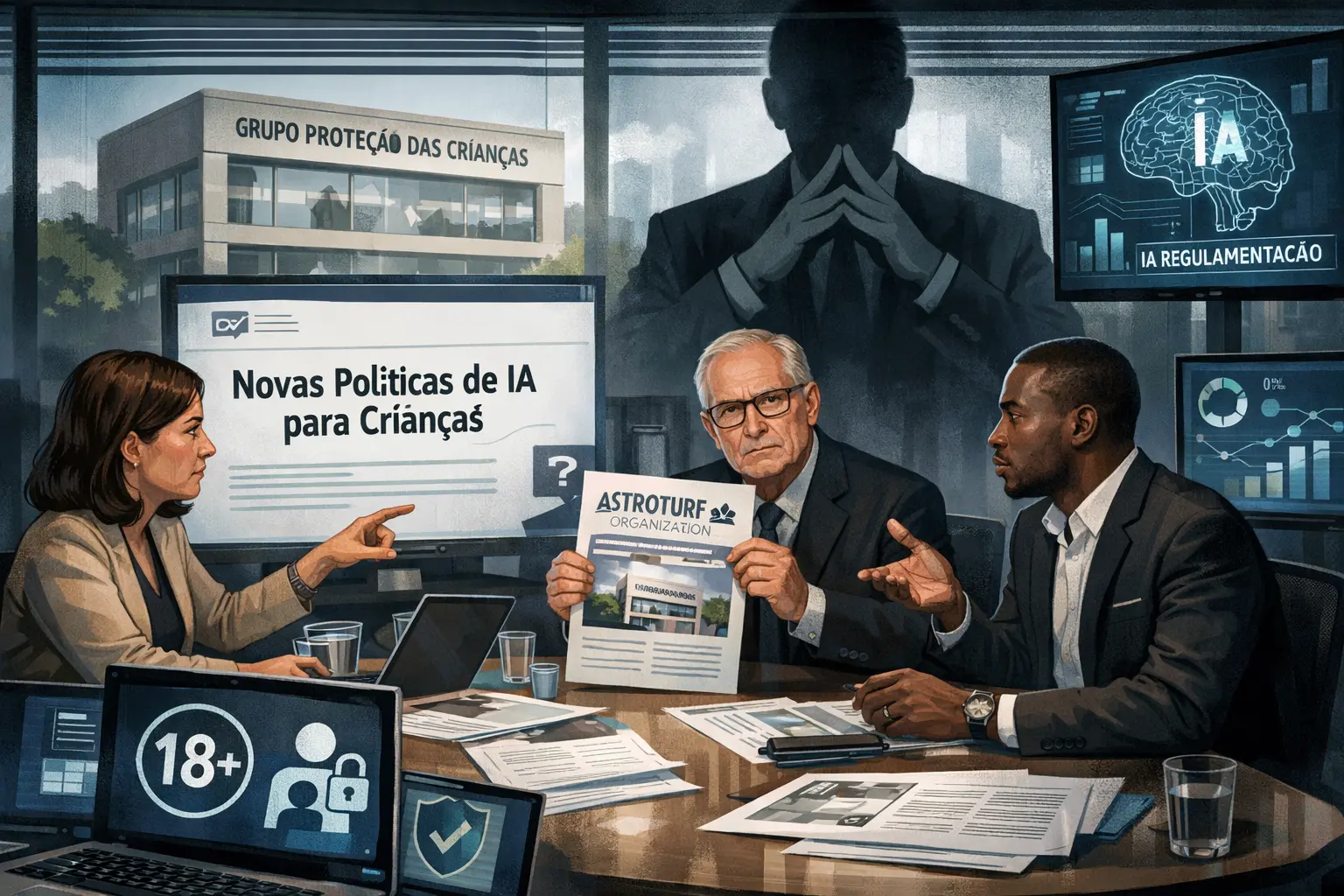

Falta de transparência levanta suspeitas

Muitas das organizações que receberam o convite não sabiam que a aliança era totalmente financiada pela OpenAI, uma das empresas mais conhecidas no setor de IA.

Segundo relatos, alguns líderes só descobriram o envolvimento da empresa depois que a aliança foi oficialmente anunciada. Ao perceberem isso, decidiram se retirar do grupo.

Alguns representantes afirmaram que se sentiram desconfortáveis com a forma como a comunicação foi feita, alegando que houve falta de clareza e possível indução ao erro.

OpenAI e o lobby por regulamentação

A OpenAI tem atuado ativamente para influenciar a criação de leis na Califórnia relacionadas à inteligência artificial. Ao mesmo tempo, vem construindo alianças com diferentes organizações para fortalecer sua posição.

Um porta-voz da aliança declarou que a OpenAI, junto com outros membros, busca promover as leis mais rigorosas dos Estados Unidos para segurança infantil em IA.

No entanto, nem todos concordam com essa abordagem.

Críticas de especialistas e organizações

Outras entidades de defesa da infância demonstraram preocupação com o protagonismo da OpenAI nesse processo. Para elas, quem deveria liderar esse tipo de iniciativa são especialistas em direitos das crianças, e não empresas de tecnologia.

Além disso, a OpenAI já se posicionou contra algumas propostas de regulamentação mais rígidas no passado, o que aumenta ainda mais a desconfiança.

Estratégia questionável?

Especialistas apontam que esse tipo de atuação — financiar um grupo sem deixar isso claro desde o início — pode ser interpretado como uma forma de “astroturfing”.

Esse termo descreve quando uma organização cria ou apoia movimentos que parecem espontâneos ou independentes, mas que na verdade são influenciados por interesses corporativos.

No caso da aliança, o nome da OpenAI nem sequer apareceu no anúncio oficial feito em 17 de março, reforçando as críticas sobre falta de transparência.

O que está em jogo

A discussão acontece em um momento importante: vários estados americanos estão considerando novas leis para regular o uso de inteligência artificial por crianças.

Ao mesmo tempo, cresce a pressão para que empresas de tecnologia:

- sejam mais transparentes,

- assumam responsabilidade,

- e coloquem a segurança infantil acima de interesses comerciais.

Resumo rápido

📌 A OpenAI financiou discretamente a “Aliança de Segurança de Pais e Crianças em IA”.

📌 Algumas organizações só descobriram isso depois e decidiram sair do grupo.

📌 Especialistas alertam que a estratégia pode enganar o público e comprometer a confiança.

Esse caso levanta uma pergunta importante: quem deve definir as regras da IA — as empresas que a criam ou a sociedade que será impactada por ela?